在China VR 2021大会上,阿里巴巴淘系技术发布了业界首个基于神经渲染的自研商品三维建模产品Object Drawer。目前,Object Drawer已经提供给部分天猫、淘宝商家使用,将在12月对外开放试用接口。届时欢迎大家体验。

团队成员在第二十一届中国虚拟现实大会上展示

团队成员在第二十一届中国虚拟现实大会上展示

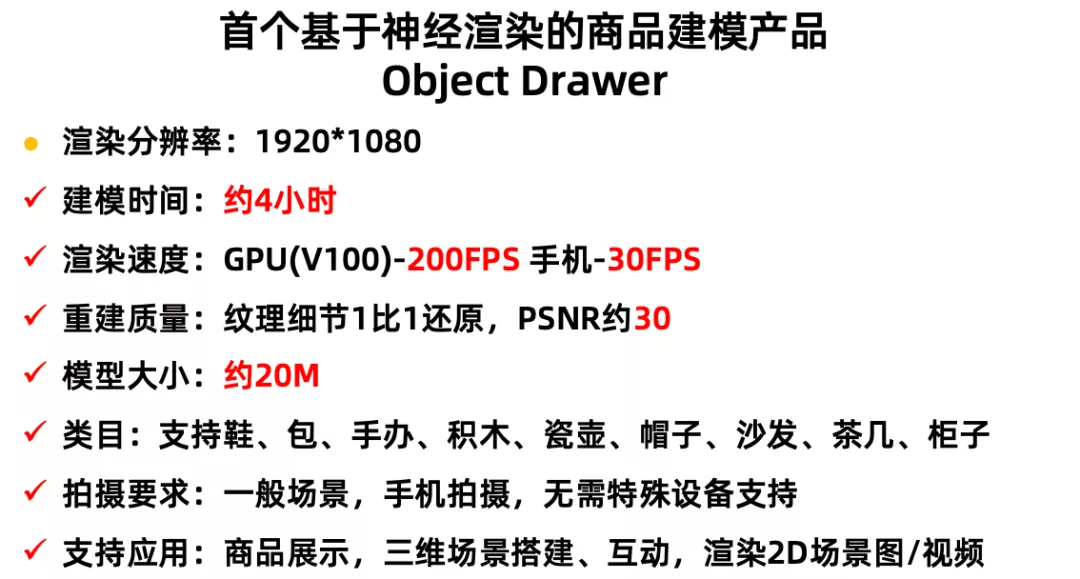

在1920*1080分辨率下,Object Drawer的推理速度可以达到200FPS,在手机上可达到30FPS,实现了实时高清可交互的三维模型。与此同时,模型的训练时间仅仅需要4小时,模型大小仅仅需要20M,同时,对于任意视角查看,商品三维模型都达到实拍照片的展示效果,实现了三维建模一直追求的自动高精度还原。Object Drawer不需要依赖特定设备,只需要手机环绕目标商品进行视频拍摄,就可以完成自动重建,所生成的三维建模效果达到高精模型还原度。

Object Drawer技术指标如下图:

背景介绍

背景介绍

随着VR/AR应用的发展,商品三维建模需求持续增加,商品建模需求可能达到现在的100倍以上。目前的商品三维建模依赖于手工建模,建模需要几小时到几天时间,费用为数百到数千元,即使是花费巨大的时间和金钱,商品还原度依然存在许多问题。传统的自动三维建模技术,需要对目标商品的形状、纹理、材质进行还原。为了提升建模成功率,建模产品对于建模环境、拍摄设备提出了许多要求。即使是这样的前提下,自动建模的三维模型还原度依然存在严重问题,弱纹理物体比如鞋、瓷壶等无法很好的重建,需要人工修复。同时,高精度材质还原,也需要人工进行大量的工作。传统建模失败案例与Object Drawer建模对比如下图:

传统建模失败案例与Object Drawer建模对比1

近几年,神经渲染技术正在飞速发展,其旨在利用神经网络来model场景和物体并可控制以及交互的渲染出photo-realistic的图像和视频。其中,NeRF及其衍生技术利用神经隐式表达来存储场景的物理几盒以及材质纹理信息,端到端的对于渲染效果进行优化,在novel view合成上取得了重大突破,也给三维重建带来了新的使点。但NeRF相关技术在实际应用中存在许多问题,部分主要问题包括:第一,推理速度、训练速度慢,1帧高清图推理时间超过50s,一个物体的建模时间长达2天以上。第二,细致纹理无法还原。第三,视角鲁棒性不好,部分视角渲染效果不理想。第三,隐式表达无法直接导入图形学工具,不支持显式使用,例如CAD场景搭配设计;同时由于只能还原拍摄场景的光照也使得NeRF模型无法支持环境光照变化的场景应用。以下为Object Drawer针对上述问题的一些解决情况。

推理速度和训练速度

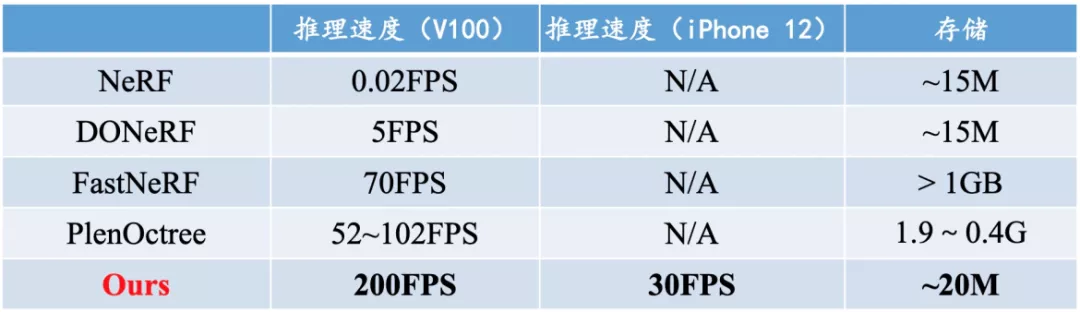

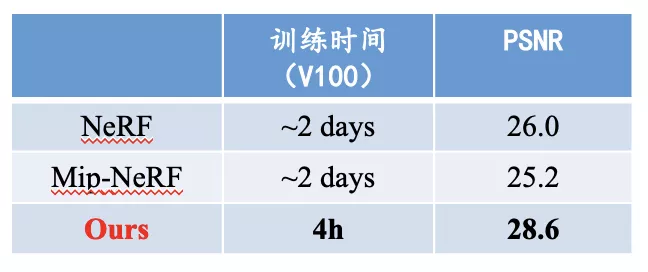

神经渲染的推理速度是近期的研究热点,原始NeRF利用volume rendering得到像素颜色值,渲染单像素通常需要forward一个MLP网络上百次。部分突破性工作,例如FastNeRF和PlenOctree,通过优化网络结构,探索几何先验,预存部分信息,在保证渲染质量的同时显著将1080p渲染速度提升到了100FPS左右,同时模型存储要求压缩到了400M左右。Object Drawer深入分析了神经推理过程中的冗余计算,提出了新的模型表示,相比NeRF实现了10000倍的推理速度提升,模型大小也控制在20M以内。

NeRF (上)与Object Drawer (下)在Novel View Extrapolation下的表现

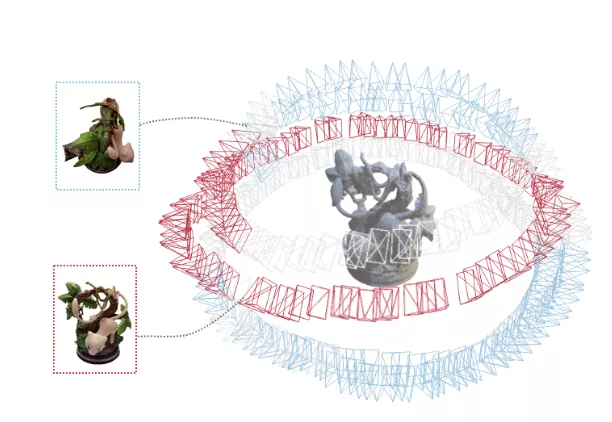

视角鲁棒性问题是神经渲染的关键问题之一。拍摄的图片无法覆盖所有视角,当输出视角发生变化和拍摄视角有一定差异时,需要神经渲染有很好的泛化能力,支持新视角图片的生成。Object Drawer,提出RapNeRF技术,利用随机视角增强与平均视角embedding技术,改进了视角鲁棒性效果。

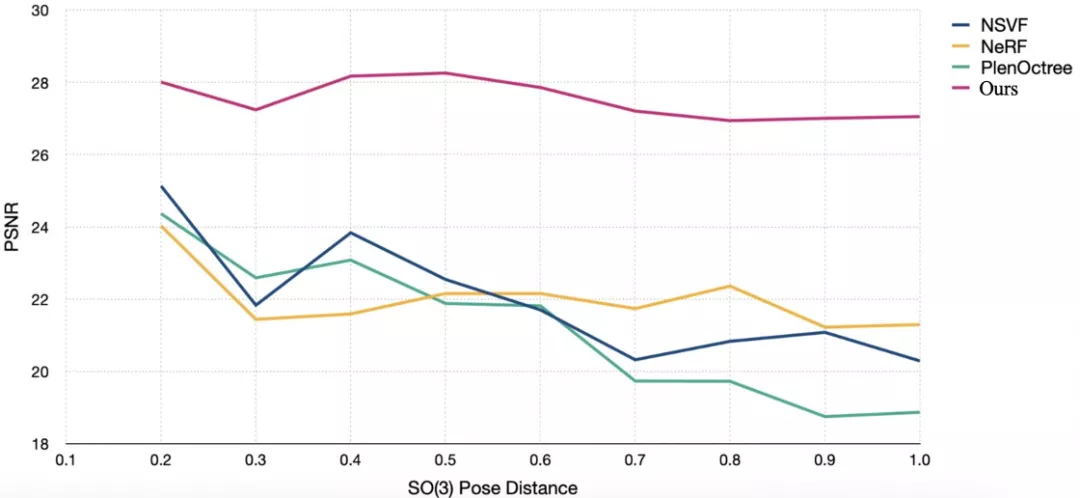

实验表明,随着视角差异的增大,NeRF等模型都出现了PSNR的大幅下降,而Object Drawer的结果,PSNR基本保持不变,case 分析可以看到视角差异很大的时候,Object Drawer也能够给出高清图像,很好的解决了这一问题。

拍摄视角与渲染视角示意,蓝色为拍摄视角,红色为渲染视角

视角差异度变化,PSNR变化

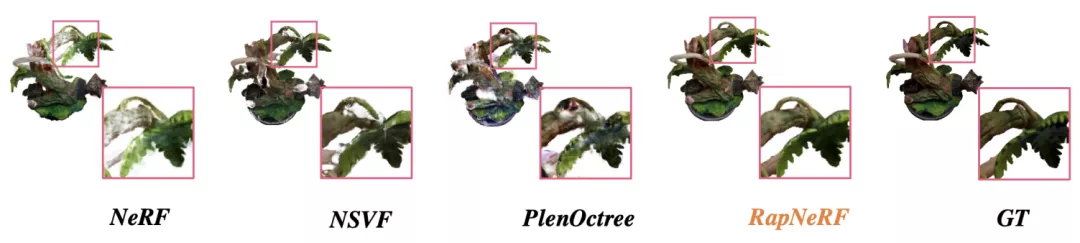

视角差异时渲染效果放大对比

三维模型表示

三维模型,需要能够支持各种三维应用,包括三维布局、渲染出图、三维互动等等。神经辐射场只能支持任意角度的渲染,使得应用受到很大的限制。

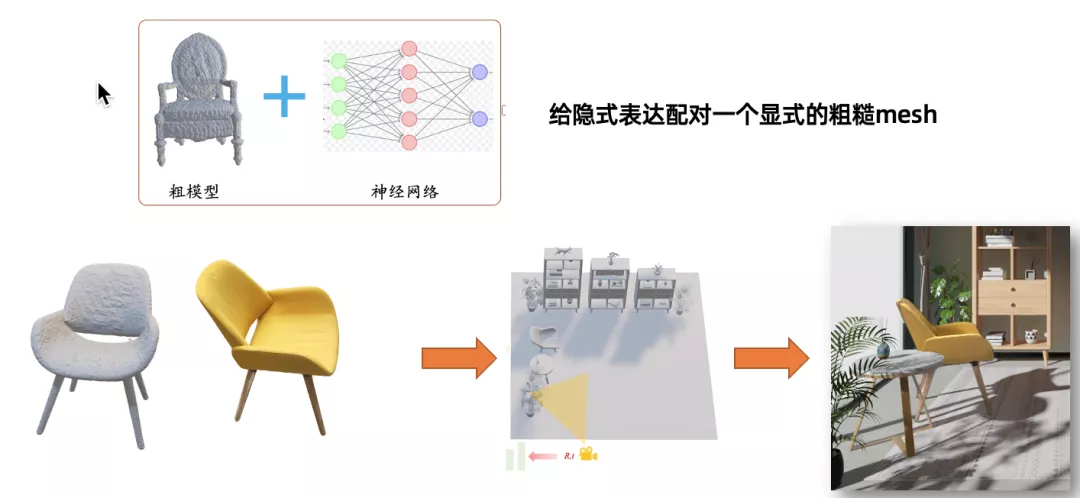

Object Drawer提出了将隐式表达与三维网格模型融合的解决方案。具体方案为,从隐式表达中提取模型的显式空间几何表达,建立mesh模型,并且通过texture mapping、材质识别等方法,形成可以应用于现有渲染引擎的三维粗模,三维粗模和神经网络共同表示一个商品。一方面,三维粗模可直接导入图形学工具,如标准高精CAD模型一般用于三维场景设计等现实应用。另一方面,神经渲染可以得到物体任意视角的高清渲染图。

三维粗模渲染

光照迁移效果

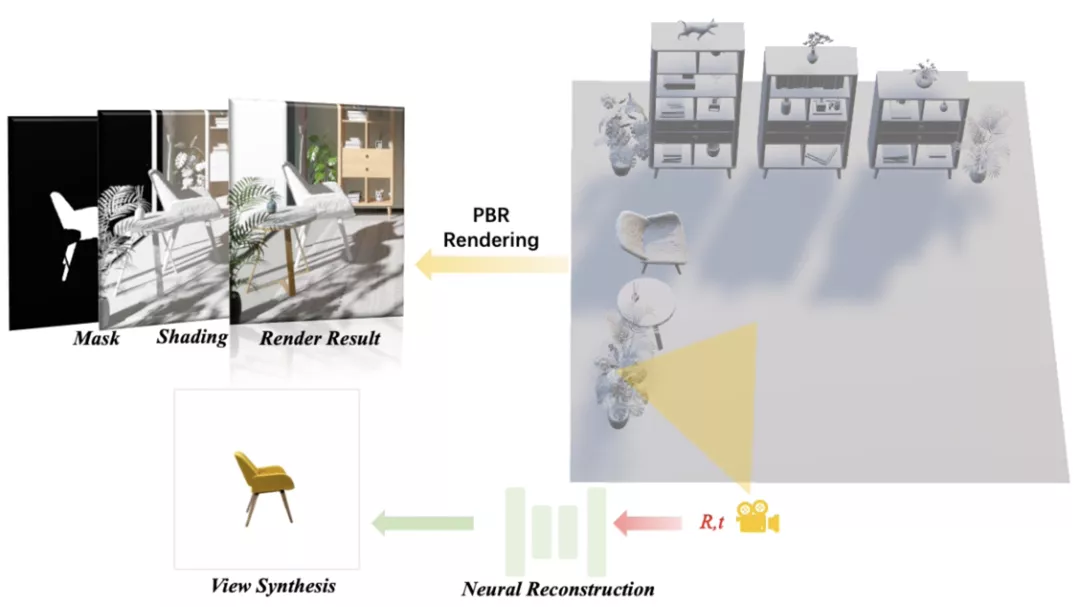

光照迁移

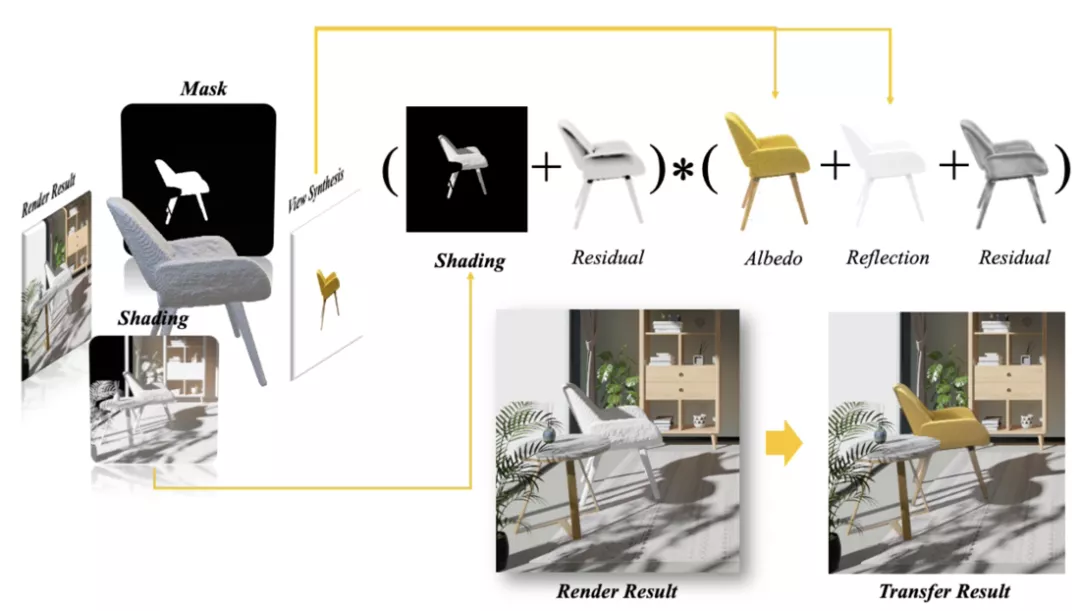

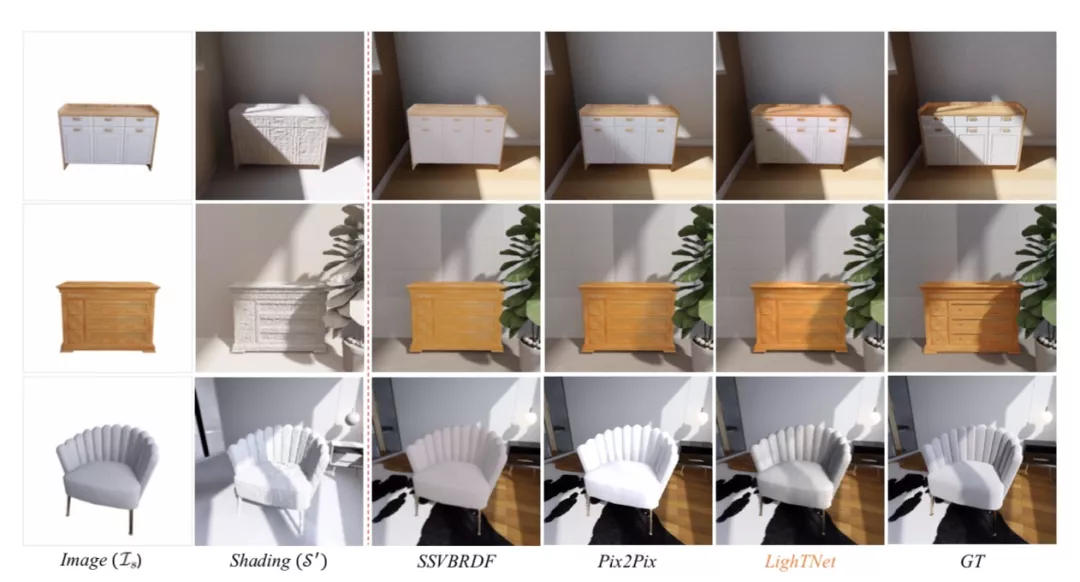

为了反应物理渲染作用于三维粗模的光照效果,如反射,阴影等,我们提出LighTNet, 将物理渲染反应在物体上的逼真光照效果迁移到神经渲染生成的物体视角图上。LighTNet以三维粗模PBR渲染得到粗糙shading、mask、depth等信息以及神经渲染结果为输入,预测相应的shading和神经渲染的修正值,修正后的shading和神经渲染可以通过本征融合得到具有光照效果的神经渲染结果;进一步用得到的带有光照效果的高清合成图替代物理渲染结果中的粗模投影可以实现逼真的场景渲染效果。在实验数据的结果表明,新方法能够适应各种复杂光源条件以及细节的阴影效果的迁移,视觉效果远超其他替代方案,在3D-FRONT测试数据集平均PSNR为30.17。

光照迁移建模效果示意

纹理细节还原

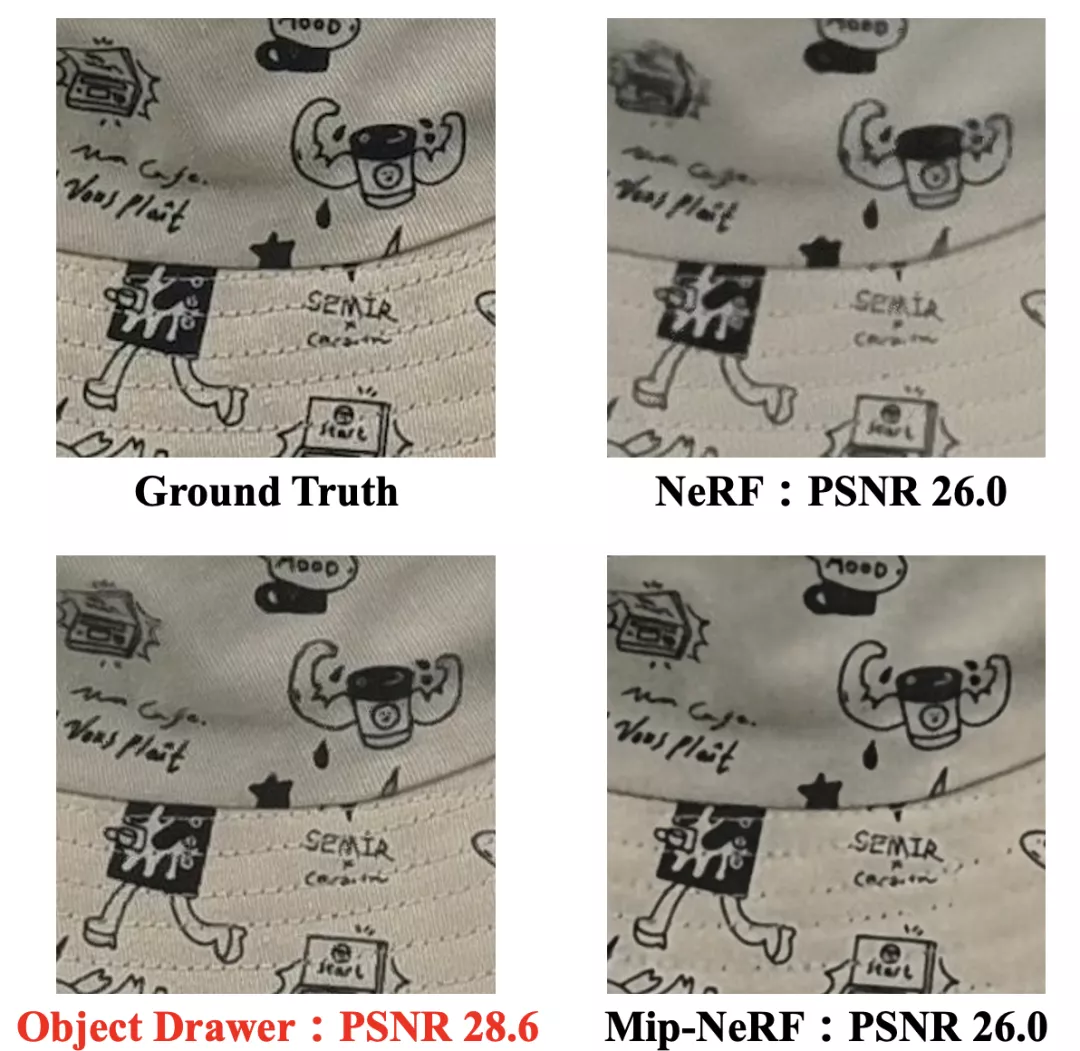

对于商品三维模型来说,纹理细节还原度非常重要,通常需要达到照片级的还原才能支持实际渲染相关产品。目前的NeRF系列研究虽然可以较高精度的perserve物体appearance,但是无法恢复纹理细节,如布料线条。Object Drawer优化了模型表达,在大幅度加速模型训练时间的同时,第一次做到了高清精细纹理还原,具体的效果如图

原始拍摄图

不同建模技术所产生的纹理细节对比

Object Drawer对神经辐射场技术进行了全面的改进和升级,实现了商品自动化高精度建模流程,并且支持电商商品模型应用,取得了很好的效果。相信不远的将来,Object Drawer将会推动商品三维模型覆盖率不断提升,为万物3D化带来可能,并加速XR相关技术应用的发展